クラスタリングとは

クラスタリングとは、ある集合を非類似度に従って、部分集合(クラスター)に分けることです。

「非類似度」とは、どれくらい似ているか(似ていないか)ということです!

非類似度の定義の仕方は様々です。

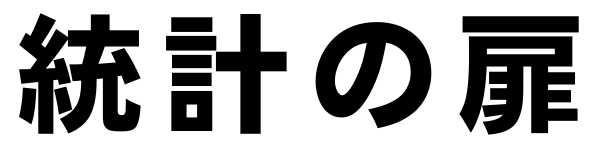

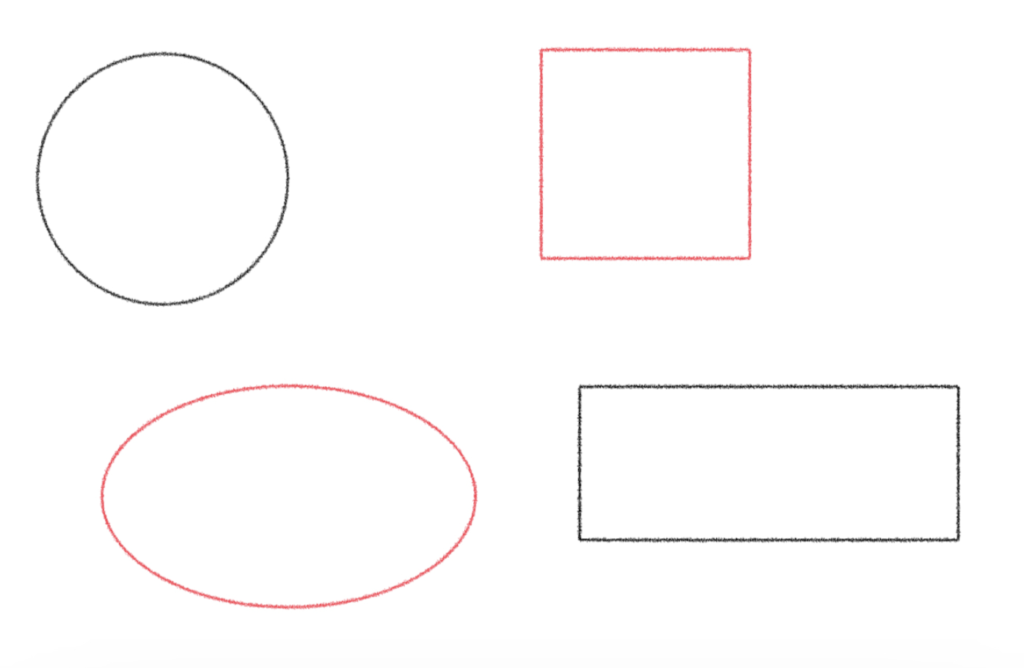

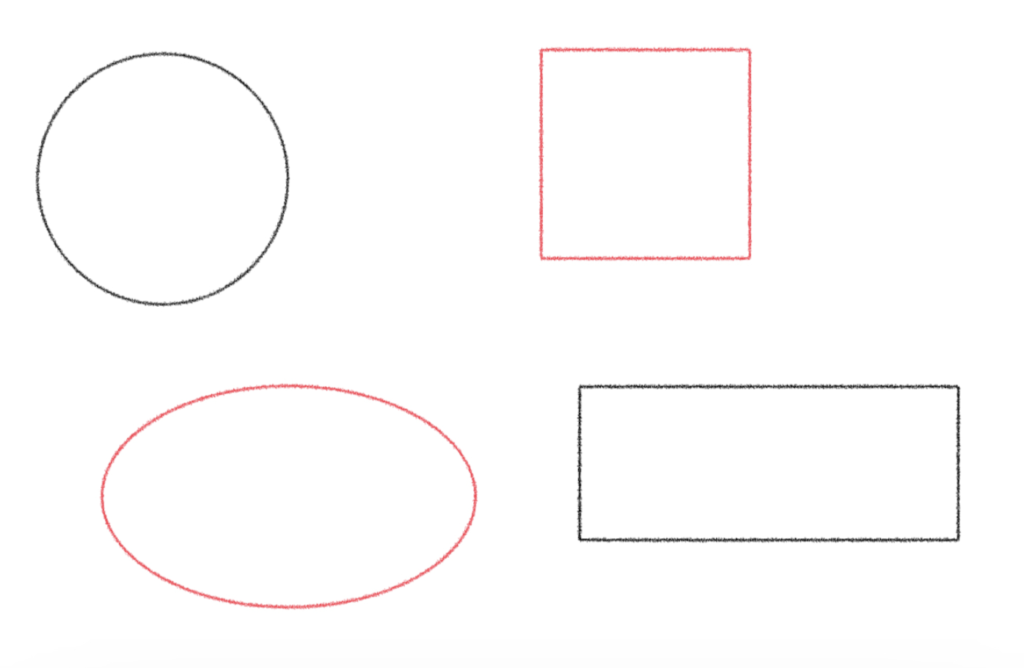

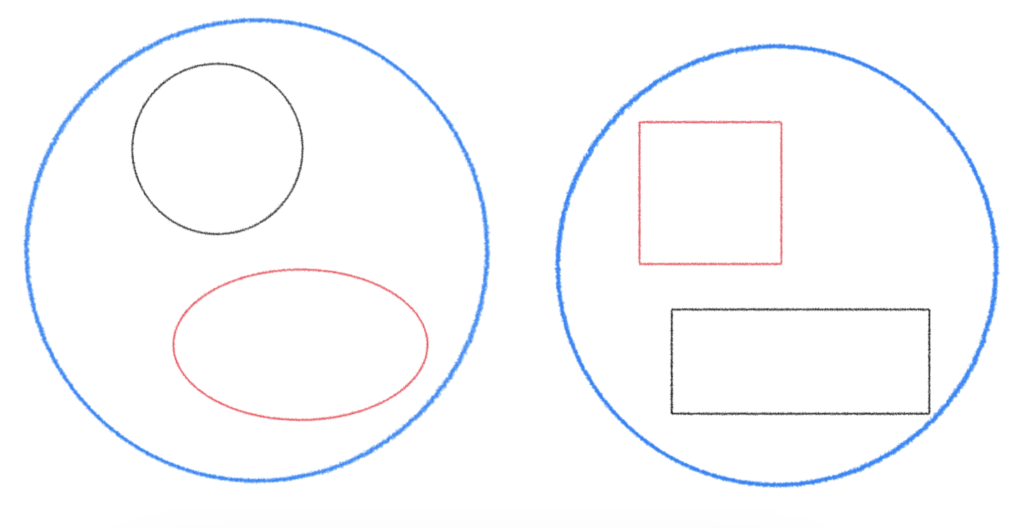

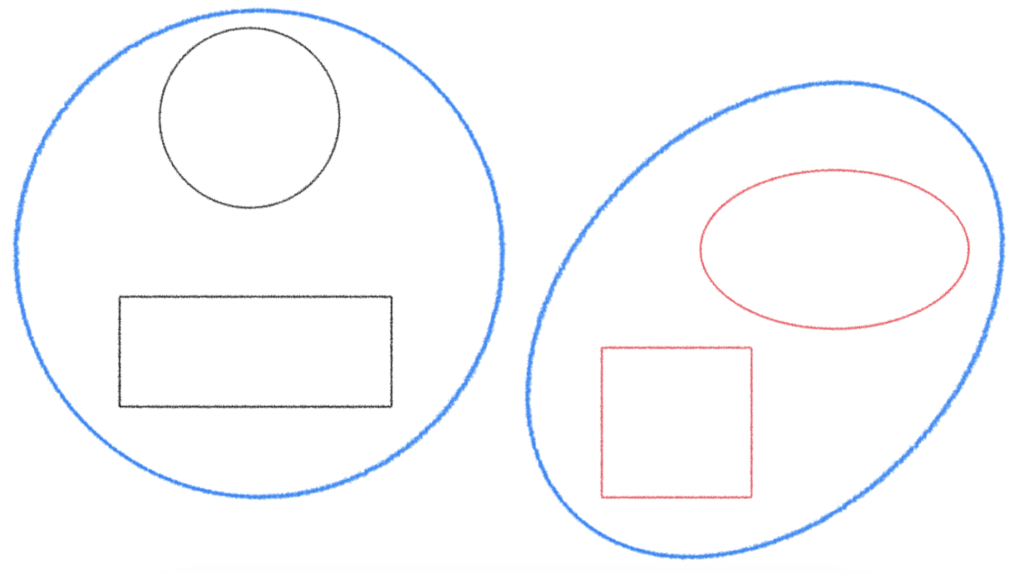

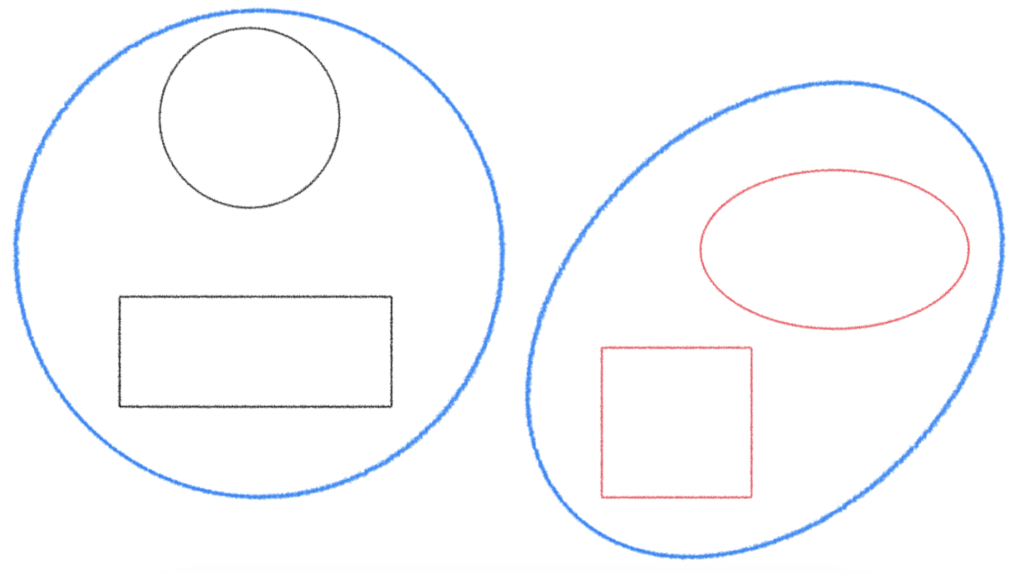

数学的な説明は後述しますが、例えば、以下のような図形の集合があったとしましょう。

「形」を基準にすると、

「色」を基準にすると、

このように、分けるための基準を非類似度、あるいは類似度や単に距離と呼ぶこともあります。

クラスタリングは大きく

・階層的手法

樹形図によって表現されるような、集団の系統発生的な構造をさぐることによってクラスターを構成しようとするものです。各個体を

・非階層的手法

クラスターの妥当性の基準として、クラスター内の変動をできるだけ小さくし、クラスター間の変動をできるだけ大きくしようとし、あらかじめクラスター数が決まっているような手法です。

クラスタリングを考える上で重要な

・個体間の類似度/非類似度

・算法(アルゴリズム)

・評価

個体間の類似度

扱うデータによって、類似度(距離)の定義は様々ですが、一般的には以下の

ある個体を、

このように、扱うデータによって様々な距離が存在しています!

算法(アルゴリズム)

アルゴリズムも距離と同様に扱うデータによって様々あります。階層的手法を扱う際の一般的なアルゴリズムは以下の

① 最短距離法

② 最長距離法

③ 郡平均法

以下、最短距離法の手順を説明します。

個体

各クラスター間(固体間)の距離を算出し、一番距離が小さい組み合わせを見つける。

距離最小の組み合わせを結合し新しいクラスターを作る。

STEP2, STEP3 を必要な回数繰り返す。

最短距離法の数値例

個体をそれぞれ

とする。まず個々の個体をクラスターとするので

としたとき、各クラスター間の

STEP1

となるので、距離が一番小さいのは

ここで、複数の個体を持つ

のように計算する。

STEP2

となるので、距離が一番小さいのは

STEP3

となるので、距離が一番小さいのは

STEP4

となり

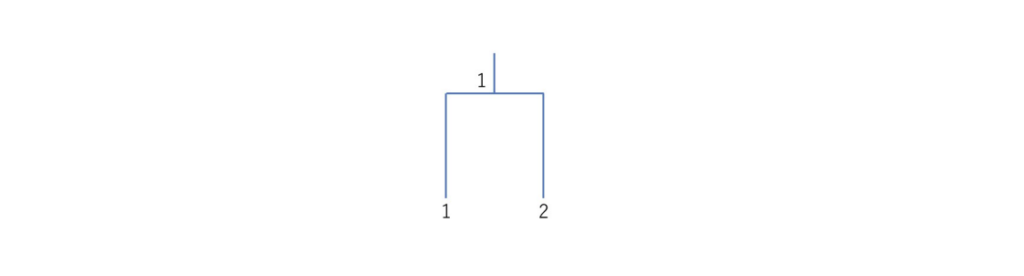

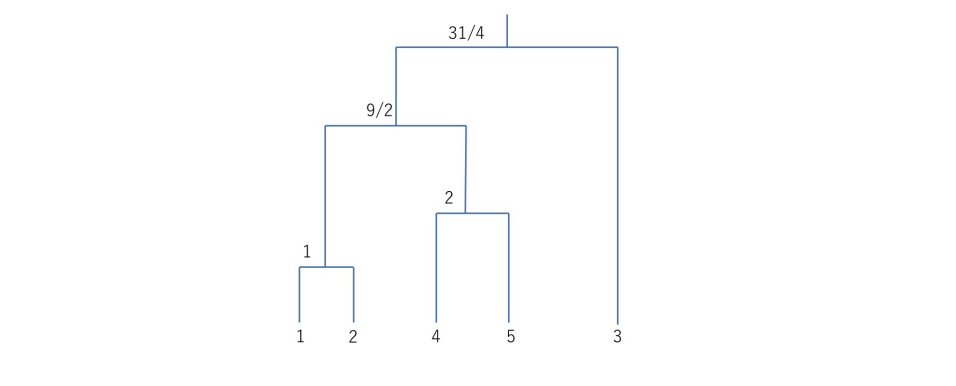

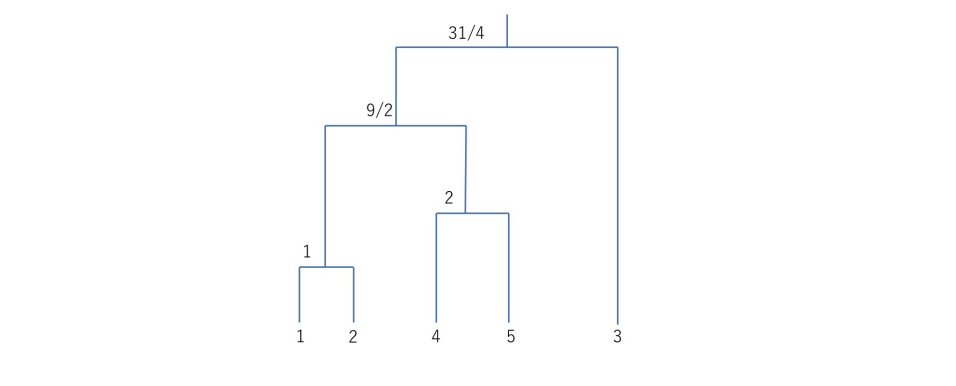

以上の計算をもとに樹形図を作成します。

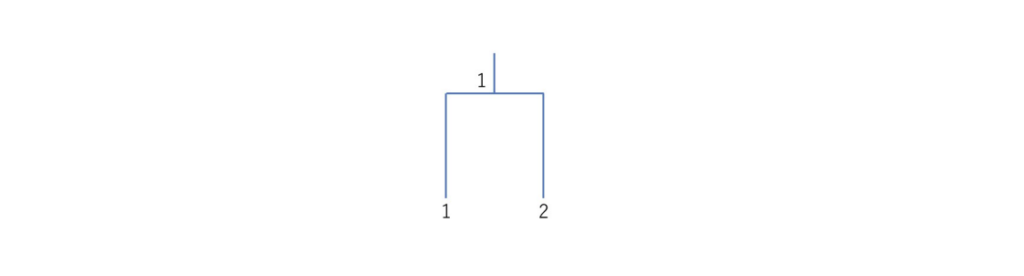

STEP1での樹形図はこちら

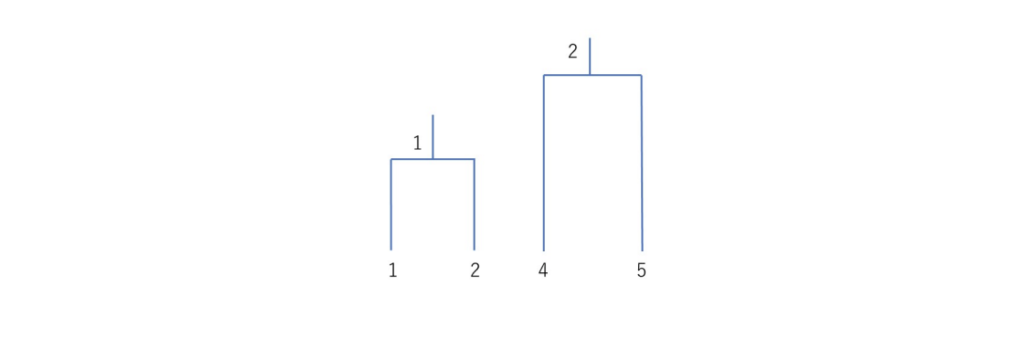

STEP2での樹形図はこちら

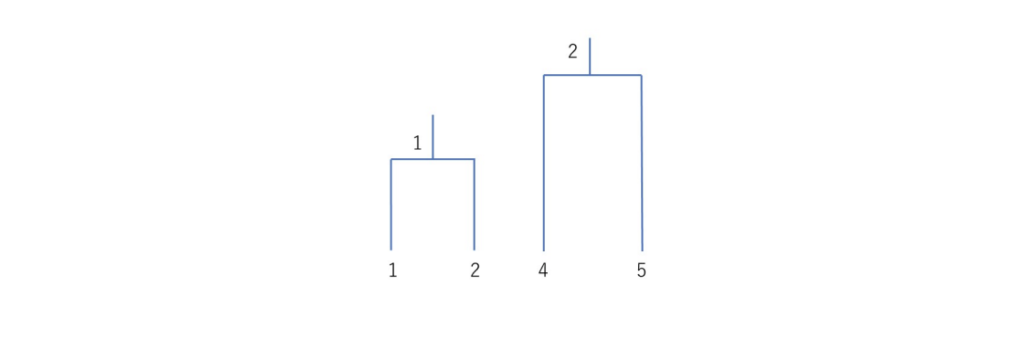

STEP3での樹形図はこちら

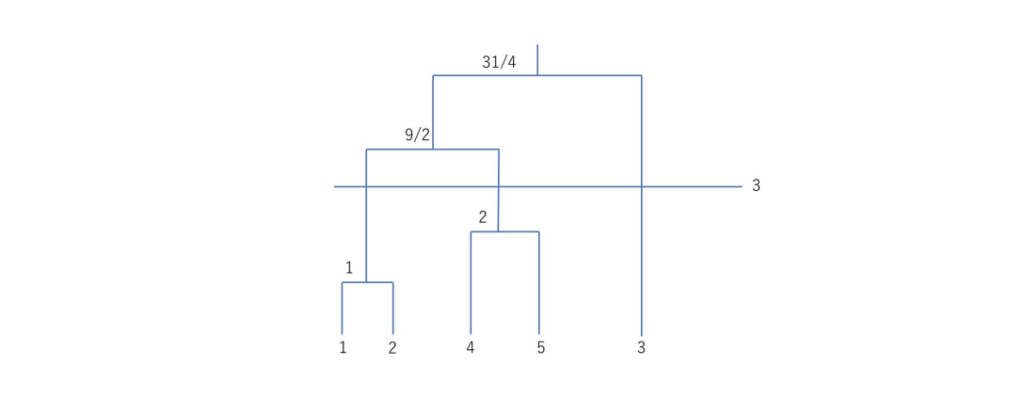

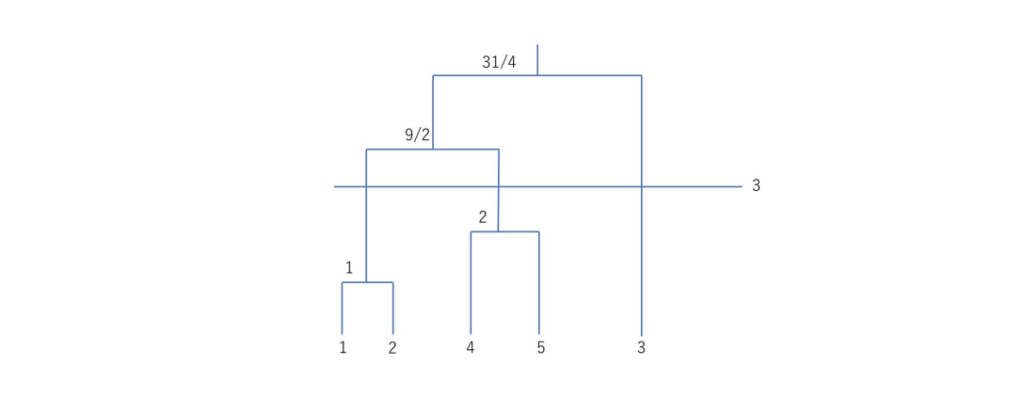

下図のように、例えば高さ3のところで切ってあげると、

のように3つのクラスターに分類される。

おわりに

さいごまで読んでいただきありがとうございました!

『統計の扉』で書いている記事

- 高校数学の解説

- 公務員試験の数学

- 統計学(統計検定2級レベル)

ぜひご覧ください!

数学でお困りの方は、コメントやXでご連絡ください。(Xはこちら)

私自身、数学が得意になれたのはただ運が良かったんだと思っています。たまたま親が通塾させることに積極的だったり、友達が入るって理由でそろばんに入れたり、他の科目が壊滅的だったおかげで数学が(相対的に)得意だと勘違いできたり。

”たまたま”得意になれたこの恩を、今数学の学習に困っている人に還元できたらなと思っています。お金は取りません。できる限り(何百人から連絡が来たら難しいかもですが…)真摯に向き合おうと思っていますのでオアシスだと思ってご連絡ください。